Fuente: Agencia ANSA

(ANSA) ROMA – El debate sobre este tema está activo tanto en Europa como en Estados Unidos. Australia ya tomó la iniciativa y Francia podría seguir esa misma senda. La restricción del acceso a redes sociales para menores es una medida radical que las grandes compañías del sector intentan contrarrestar mediante nuevas limitaciones en sus propias plataformas.

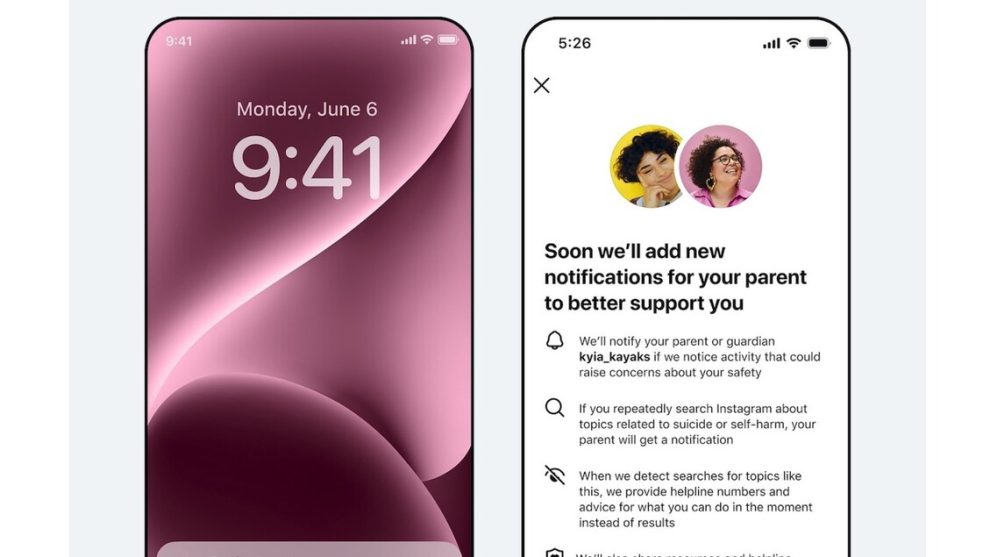

La acción más reciente afecta a Instagram, que ha lanzado en Estados Unidos, Reino Unido, Australia y Canadá —con planes de extenderla a otras naciones antes de finalizar el año, entre ellas Italia— una función que notifica a los padres si los adolescentes realizan búsquedas repetidas de términos sensibles relacionados con el suicidio y la autolesión.

Franz Russo, experto en comunicación digital, explicó a ANSA: “Es la primera vez que una plataforma social introduce un sistema de notificación proactiva de este tipo”.

“Hasta ahora, las principales plataformas, desde TikTok hasta YouTube y Snapchat, solo bloqueaban búsquedas directas de términos sensibles y mostraban recursos de apoyo, pero sin involucrar activamente a los padres”, añadió.

Las alertas enviadas por Instagram llegarán vía correo electrónico, SMS o WhatsApp, según la información de contacto disponible, además de una notificación dentro de la aplicación misma. Al acceder a ella, los padres encontrarán una sección específica con recomendaciones sobre cómo tratar el tema con sus hijos, elaboradas conforme a lineamientos expertos.

En diciembre del año pasado, Australia estableció la prohibición del uso de redes sociales para menores de 16 años. A finales de enero, la Asamblea Nacional francesa aprobó un proyecto que impide el acceso a estas plataformas a menores de 15 años. En Italia, el partido Lega presentó una propuesta similar en la Cámara de Diputados.

Russo comentó: “Esto representa un cambio importante que responde a una demanda concreta de muchas familias”.

“Disponer de herramientas para identificar señales de malestar antes de que sea demasiado tarde es fundamental. Que la alerta se active solo tras búsquedas repetidas —y no en el primer intento— muestra un esfuerzo por equilibrar la protección con el respeto a cierta autonomía del adolescente. No se trata de una vigilancia intrusiva, sino de una alerta diseñada para casos que podrían indicar una necesidad real de apoyo”, aclaró.

Además, está el tema de la inteligencia artificial. Meta está desarrollando notificaciones similares dirigidas a los padres en algunas interacciones con su chatbot Meta AI, para informarles si sus hijos adolescentes intentan iniciar conversaciones sobre suicidio o autolesión.

Este asunto es delicado y ha desencadenado decenas de demandas judiciales en Estados Unidos contra grandes empresas del sector IA, acusadas de crear chatbots adictivos, complacientes y sin medidas efectivas para proteger a los menores.

Russo concluyó: “Extender este sistema de alertas también a las conversaciones con Meta AI es un paso lógico y necesario”, considerando que cada vez más adolescentes recurren a chatbots para buscar respuestas o expresar malestares que no comparten con su entorno”.

TODOS LOS DERECHOS RESERVADOS © Copyright ANSA

Este contenido fue hecho con la asistencia de una inteligencia artificial y contó con la revisión del editor/periodista.