Madrid, 13 Nov (EUROPA PRESS)-.

Europa Press, junto con la empresa española AygLOO, especializada en inteligencia artificial, ha finalizado la primera fase de un proyecto desarrollado con financiación del Centro para el Desarrollo Industrial y Tecnológico (CDTI), que pretende hacer frente a los crecientes retos que plantea la propagación de noticias falsas en Internet.

La salvaje propagación de bulos en X (antes Twitter) en los días posteriores al atentado de Hamás en Israel y la posterior advertencia a Elon Musk por parte de la Comisión Europea por incumplir las nuevas normas de la UE contra la desinformación es uno de los últimos ejemplos de este desafío.

Con el objetivo de dar un paso en esta dirección, la prensa europea ha emprendido un proyecto de investigación y desarrollo para crear un sistema de alerta temprana como primera “prueba” contra posibles bulos y para combatir la intrusión de nuevas tecnologías como la inteligencia artificial que podrían facilitar la creación a gran escala de este tipo de contenidos. Puesta en marcha.

El objetivo a medio plazo es dotar a periodistas e investigadores de herramientas para detectar rápidamente noticias falsas utilizando tecnologías de inteligencia artificial como NLP (natural language processing), STS (semantic text similarity), NLI (natural language inference), deep learning y XAI (explainable artificial intelligence).

Para lograrlo, se están desarrollando dos estrategias principales. Por un lado, se está construyendo y actualizando diariamente una gran base de datos de verificaciones de hechos en diferentes idiomas, utilizando modelos de similitud semántica para comprobar si los bulos ya han sido verificados por actores independientes.

Las informaciones falsas suelen repetirse a lo largo del tiempo. Por eso esta herramienta pretende detectar bulos que se repiten muchas veces en el discurso público.

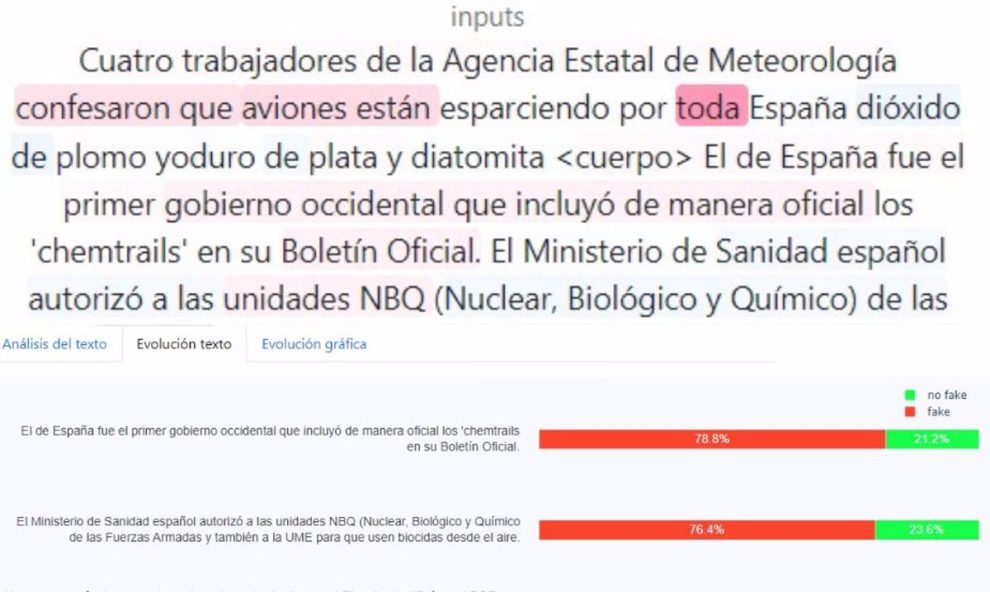

Además, con el objetivo de abordar este problema desde diferentes ángulos, durante el desarrollo del proyecto se entrenó otro modelo utilizando miles de ejemplos de bulos escritos en español y artículos de noticias reales redactados por expertos de agencias de noticias. A partir de este entrenamiento, y utilizando herramientas de PNL y aprendizaje profundo, este modelo puede evaluar si un texto es falso o verdadero en función de cómo está escrito. Sin evaluar la autenticidad o falsedad del texto, este análisis pretende actuar como una alerta temprana para periodistas e investigadores.

Dado el riesgo de sesgo y la falta de transparencia en el uso de algoritmos de inteligencia artificial, esta parte del proyecto incluye un módulo de explicabilidad, que pretende dar a los investigadores “pistas” de por qué el modelo considera falso un texto.

La aplicación, aún en fase de desarrollo, será probada por organismos independientes de verificación y otros agentes de la sociedad civil en el marco de la segunda fase del proyecto.

Una de las prioridades de la Comisión es combatir la difusión de información falsa que desestabiliza las instituciones democráticas y desacredita a los ciudadanos.