MADRID, 29 de febrero. (Portal/EP) – Adobe ha presentado Project Music GenAI Control, una herramienta experimental de creación y edición de audio impulsada por inteligencia artificial general (IA) para que los usuarios puedan crear nueva música a partir de indicaciones de texto, así como editar y luego personalizar dicha sección. Además de las herramientas de edición de imágenes con Photoshop, la gestión de documentos con Acrobat y el diseño digital con InDesign, el editor de software estadounidense también pretende ofrecer a los creadores de audio, como podcasters en streaming, podcasters o músicos, opciones para realizar sus proyectos con una edición de audio específica.

y herramientas de creación sintéticas impulsadas por IA. En este sentido, Adobe ha presentado un nuevo trabajo experimental desarrollado por Adobe Research, llamado Project Music GenAI Control, basado en una plataforma formada por varias herramientas impulsadas por IA sintética para editar y crear sonidos y música a partir de instrucciones de texto. Tal y como explica Adobe en un comunicado en su blog, para empezar a crear sonidos, los usuarios simplemente deben introducir un mensaje de texto descriptivo sobre el tipo de sonido que quieren crear.

Por ejemplo, el jazz triste o la música rock poderosa. El modelo de IA sintética de Project Music GenAI Control luego usa IA para crear música según las instrucciones ingresadas en el texto. Además, una vez creado el audio, los usuarios podrán editar esa parte ya que está directamente integrada en el flujo de trabajo de la plataforma Adobe.

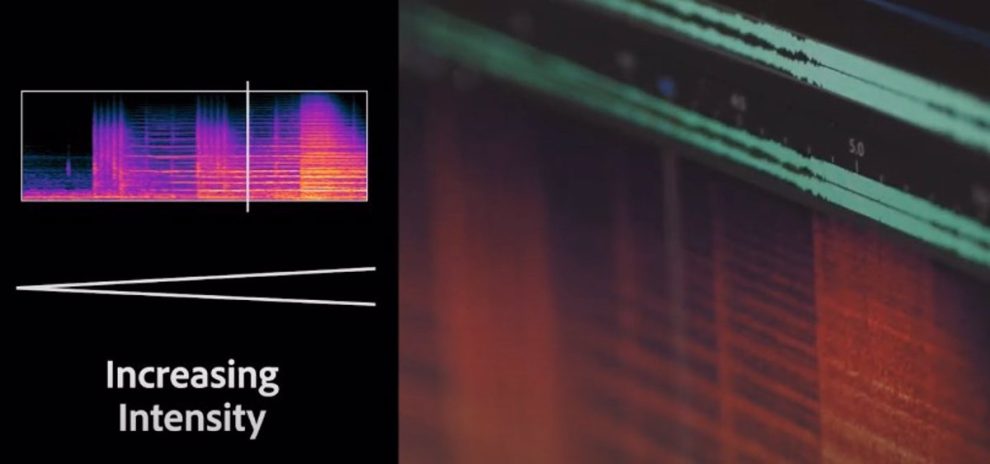

Por ello, la compañía ha aclarado que los usuarios podrán gestionar el audio a través de una sencilla interfaz en la que tendrán que ajustar el tiempo, la estructura y los patrones de repetición de la música creada para ellos hasta crear exactamente el tono deseado. Asimismo, podrán editar cuestiones como cuándo aumentar o disminuir la intensidad del sonido, alargar la duración de una nota o remezclar la pista con otras melodías. Siguiendo esta línea, Adobe destaca que otra opción que ofrece la plataforma es abordar los puntos débiles en el flujo de trabajo de un extremo a otro.

Es decir, un sistema donde en lugar de que el usuario tenga que cortar música manualmente para crear introducciones, finales y pistas de audio de fondo, Project Music GenAI Control lo hace automáticamente. Como agregó Nicholas Bryan, investigador científico senior de Adobe Research, con Project Music GenAI Control, la IA sintética se convierte en el cocreador del usuario. De hecho, según deja claro, la plataforma destaca porque no sólo es útil para crear sonidos, sino que también eleva las capacidades de trabajo al nivel de Photoshop.

Les brinda a los creadores el mismo control profundo para dar forma, ajustar y editar sus sonidos. Añadió que es una especie de control de música a nivel de píxeles. Para lograr esta base, la compañía se apoyó en su línea de modelos de IA, Firefly, que, recuerda, se ha convertido en uno de los modelos de generación de imágenes más utilizados, con más de 6 millones de fotografías hasta el momento.

Con todo esto en mente, Adobe enfatiza que está comprometido a garantizar que su tecnología se desarrolle de acuerdo con principios éticos de responsabilidad y transparencia en IA. Por ejemplo, en el caso del contenido creado con Firefly, se incluyen automáticamente identificadores de contenido, es decir, etiquetas con las que se identifica el contenido digital allí donde se utiliza, aparece como copia o archivo. Actualmente, Project Music GenAI Control es un trabajo experimental que Adobe está desarrollando en colaboración con la Universidad de California en San Diego, así como con la Escuela de Ciencias de la Computación de la Universidad Carnegie Mellon.